OpenClaw 一键管理脚本(安装/更新/管理入口):

| |

提示:装好后在 OpenClaw 的 API 管理里新增 NVIDIA Build 的 OpenAI 兼容 provider(本文下方给出 baseUrl、model-id 与配置示例)。

一条重要更新:NVIDIA Build 已开放 kimi-k2.5,并且可以免费使用

这两天 NVIDIA Build 上线了 moonshotai/kimi-k2.5 模型,并提供 OpenAI 兼容接口。这意味着你可以用非常低的接入成本,把它接到 OpenClaw(以及各种支持 OpenAI 接口的 Agent / 工具)里进行对话与自动化工作流调用。

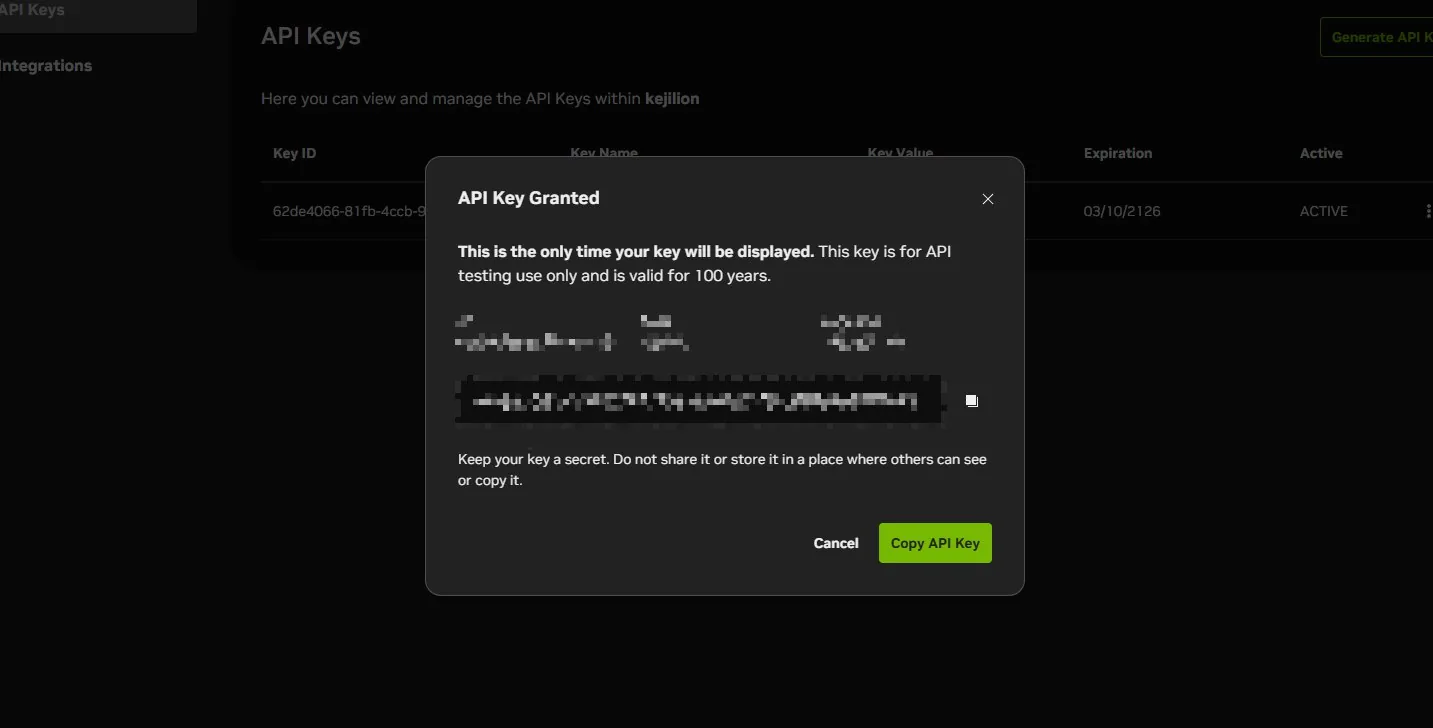

第一步:申请 NVIDIA Build API Key

先到 NVIDIA Build 的 API Keys 页面创建 Key:

https://build.nvidia.com/settings/api-keys

图1:在 NVIDIA Build 生成 API Key。注意不要把 Key 明文发到群里或写进仓库。

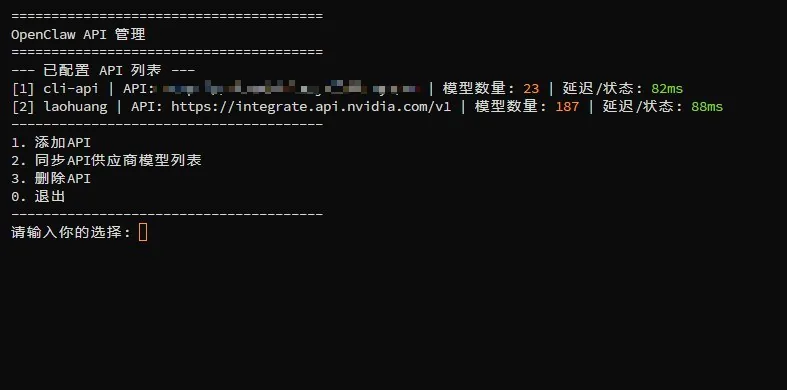

第二步:确认接口参数(OpenAI 兼容)

你需要记住三个关键参数:

- API Key:你刚创建的 key

- Base URL(OpenAI 兼容):

https://integrate.api.nvidia.com/v1 - Chat Completions Endpoint:

/chat/completions - Model ID:

moonshotai/kimi-k2.5

有些工具会让你直接填写"完整 endpoint",也就是:

| |

但更常见、也更推荐的写法是只填 base URL(到 /v1),由客户端自动拼接 /chat/completions。

图2:OpenAI 兼容接入参数示例:base-url 与 model-id。

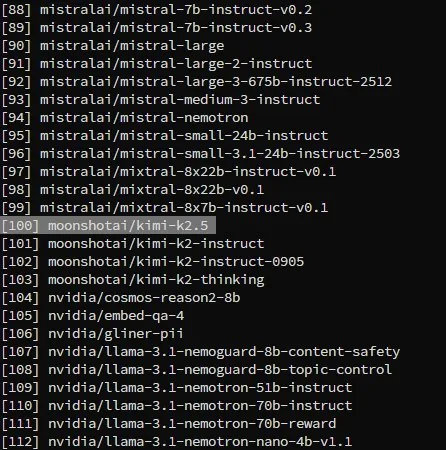

第三步:接入 OpenClaw(两种写法都给你)

OpenClaw 侧只要把它当作一个"OpenAI 兼容提供方(provider)“配置进去即可。下面给两种写法,优先推荐 A;如果你遇到客户端拼接路径不兼容,再用 B 作为兜底。

A. 推荐写法:baseUrl 写到 /v1(更通用)

示例(请把 YOUR_NVIDIA_KEY 换成你自己的 key):

| |

解释:

api使用 OpenAI Chat Completions 兼容模式(对应/chat/completions)。baseUrl建议写到/v1,由客户端拼接后续路径。model用moonshotai/kimi-k2.5。

B. 兜底写法:baseUrl 直接写到 /v1/chat/completions(少数工具需要)

如果你发现某些环境下客户端没有自动拼接 /chat/completions,可以尝试:

| |

注意:不同工具对 baseUrl 的语义略有差异。如果 B 仍不工作,优先回到 A,并检查工具是否要求单独填写 endpoint。

图3:在 OpenClaw 中配置 provider(OpenAI 兼容)示例。建议遮挡 API Key,只展示 baseUrl 与 model-id。

第四步:如何验证是否接入成功

最简单的验证方式:

- 改完配置后,按提示 重启 gateway 使配置生效(如果你刚刚用

openclaw config set修改过配置,也同样建议重启)。 - 在你的聊天入口里发一句简单的测试对话(例如"用一句话解释 TCP 三次握手”)。

- 观察 OpenClaw 的状态输出里 provider/model 是否显示为你设置的

nvidia-kimi/moonshotai/kimi-k2.5(不同版本显示字段可能略有差异)。

如果你使用的是命令行,也可以先看一下 OpenClaw 自身状态是否正常:

| |

注意事项与坑位提醒

- 免费不等于无限额度:免费政策、速率、并发和每日额度可能变化,具体以 NVIDIA Build 实际策略为准。

- 不要把 API Key 写进仓库:建议放环境变量或本机配置文件,并避免在截图/日志中泄露。

- baseUrl 兼容差异:优先用

https://integrate.api.nvidia.com/v1;只有在客户端不拼接路径时才用完整 endpoint 写法。 - 网络与代理:国内环境注意代理/网络策略对

integrate.api.nvidia.com的可达性,遇到超时优先排查 DNS 与出站规则。

扩展:同类 OpenAI 兼容接口(Minimax M2.5、GLM 5)

如果你正在做多模型对比或准备不同的备选线路,除了本文的 NVIDIA Build(kimik2.5)之外,也可以关注以下两类常见的 OpenAI 兼容接入:

- Minimax M2.5:在一些聚合平台或官方渠道提供 OpenAI 兼容入口,适合作为备选模型源。

- z.ai 的 GLM 5:GLM 系列在部分平台同样提供 OpenAI 兼容接口,接入方式与本文类似,核心仍是 baseUrl + apiKey + model-id。

需要注意:不同平台的免费额度、速率限制与模型命名可能随时变化。建议你在 OpenClaw 中为每个 provider 单独建一个配置段,并保留一个可用的"兜底模型",以免临时策略变动影响日常工作流。

结语

对已经在用 OpenClaw 或者各种 Agent 框架的人来说,NVIDIA Build 提供的 OpenAI 兼容接口意味着接入成本非常低:拿到 key、填好 baseUrl 和 model-id,就可以快速把 kimi-k2.5 用起来。后续如果你希望把它做成一键迁移/一键切模型的体验,也很适合进一步做成脚本化模板。

如果你已经接入成功,也欢迎反馈 baseUrl 兼容情况(A 还是 B)。我后续可以整理成更稳的 OpenClaw 配置模板与排障清单。